Polémica en Meta con sus gafas

- Admin

- hace 13 horas

- 2 Min. de lectura

Otra vez vuelve a saltar la polémica alrededor de una empresa vinculada con el universo IA. Esta vez la empresa que está en el centro de la polémica es META.

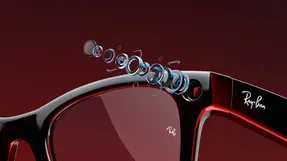

Y los problemas no vienen por el uso de la famosas gafas Ray-Ban Meta, sino por los procesos que hay detrás de las mismas para entrenar el sistema.

Es decir, otra vez estamos al frente de un problema de transparencia y ética- uno de los talones de Aquiles de la IA.

La “crisis de reputación”, viene dada porque META tiene su centro de validación de contenido- el que los usuarios visualizan a través de las gafas en KENIA y resulta que el proceso es más manual de lo esperado (como muchos otros que se dan en India y Sudeste Asiático).

Los algoritmos no son ni mucho menos perfectos y la participación humana en su entreno sigue siendo clave, es por ello que todos estos centros de validación de contenido realmente lo que tienen son grandes equipos de personas viendo, revisando, aprobando y vetando contenido.

El caso es que en KENIA, los validadores están teniendo acceso a todo el contenido que los usuarios visualizan y eso es muy, muy complejo de controlar, ya que nuestra vista queriendo o sin quererlo es una gran ventana al mundo.

La investigación sobre la "Polémica en Meta con sus gafas" fue realizada por dos medios suecos, el Svenska Dagbladet y el Göteborg-Posten y revela que en KENIA estan visualizando, entre muchas otras casos de desnudos, datos bancarios, escenas íntimas, …

En el centro de validación el equipo lo que realiza es entrenar el modelo y para ello, etiquetan objetos en los fotogramas, trazan contornos, validan descripciones, revisan transcripciones y sobretodo validan que el asistente ha respondido de forma correcta a las solicitudes de los usuarios.

Evidentemente, las empresas responsables de estos centros de validación (que son subcontratas), trabajan con estrictos contratos de confidencialidad, pero al igual que pasa con los equipos que hacen las validaciones en RRSS, esto no quita que detrás estén personas humanas que visualizan el contenido.

Asimismo, en la letra pequeña (esa que no nos leemos nunca) de la aplicación de la Ray-Ban Meta dice que para poder dar respuesta el contenido visualizado puede ser tratado por máquinas y/o personas.

Ahora bien, esto que en el fondo es aceptado por los usuarios (hasta ahí legal), puede estar a parte de vulnerando aspectos éticos, normativa legal, ya que bajo la ley de la UE, toda información de un ciudadano de la UE, debe ser tratada y ser residente dentro del territorio de la UE- y evidentemente si la misma se envía a Kenia esto no sucede así.

El Gobierno de Irlanda, donde META tiene su sede Europea ya ha abierto una investigación y solicitado respuestas a Meta.

Así que ahora hay abierta otra investigación más sobre META que tendrá que dar respuestas y probablemente recibir una nueva sanción.

Pero el problema de fondo, ya no es que los datos salgan de la UE (que es una infracción), sino la falta de transparencia que otra vez se vuelve hacer patente en una solución de IA y que en el fondo acaban lastrando su posicionamiento y percepción por parte de los usuarios.

Comentarios